AI의 세계에서 OpenAI와 Google이 어떤 일을 해왔는지 들어보셨을 겁니다. 그리고 이제 Meta의 라마 LLM(대규모 언어 모델)은 특히 오픈 소스라는 특성으로 인해 점점 더 중요한 역할을 하고 있습니다. Meta는 최근 라마 3 AI 모델을 출시하여 큰 화제를 불러일으키며 이 분야를 크게 뒤흔들고 있습니다.

그 이유는 여러 가지가 있습니다. 무료로 사용할 수 있고, 폭넓은 사용자층을 확보하고 있으며, 오픈 소스라는 점 등이 그 이유 중 일부입니다. 라마 3가 AI 업계에 돌풍을 일으키며 앞으로의 미래를 좌우할 수 있는 이유를 알아보세요.

라마 3는 정말 좋습니다

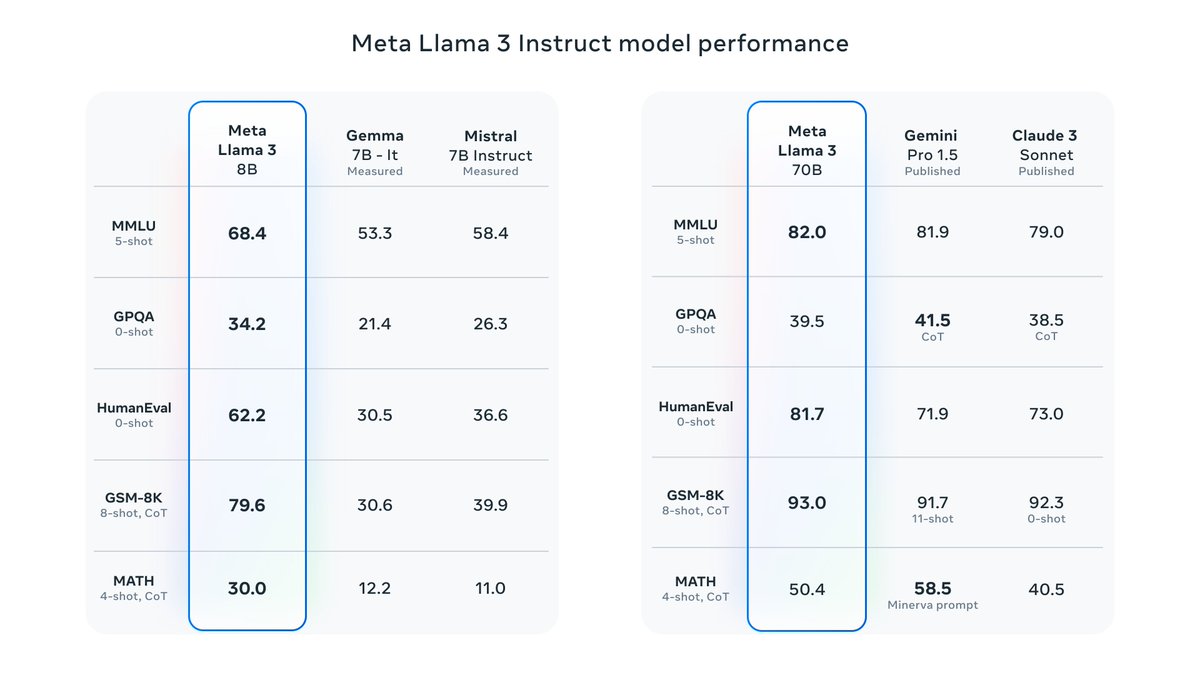

ChatGPT나 Llama 3와 같은 인공지능이 현실 세계에서 얼마나 유용한지에 대해서는 소가 집에 올 때까지 토론할 수 있지만, 보드 게임 규칙을 가르치는 데는 나쁘지 않지만 이러한 인공지능의 능력에 대한 몇 가지 벤치마크를 보면 Llama 3가 뚜렷한 우위를 점하고 있습니다.

일부 라마 3 개발자들은 최신 모델과 주요 대안을 비교하는 테스트를 공유해왔으며, 많은 경우 라마 3가 가장 우수한 것으로 나타났습니다. 이러한 벤치마크는 수학, 자연어 처리, 코딩 능력, 일반적인 지식과 이해를 다룹니다.

하지만 이들의 말만 믿지 마세요. AI 아레나에서 라마 3와 다른 다양한 AI 모델을 테스트해 볼 수 있습니다.

방대한 기존 사용자 기반

OpenAI가 ChatGPT를 출시했을 때 초기에는 일부 이해관계자가 있었지만, 유기적으로 사용자를 늘려야 했습니다. 놀라울 정도로 빠르게 성장하여 GPT 3 및 GPT 4 모델의 성공에 이어 수천만 명의 사용자를 등록했습니다. 하지만 Meta의 라마 3는 이미 Facebook, Instagram, WhatsApp, Messenger는 물론 이러한 모든 서비스의 웹 앱 버전에서 사용할 수 있는 Meta AI에 내장되어 있습니다.

이는 수백만 명의 기존 사용자가 아닙니다. 수십억 명입니다. 메타가 더 많은 데이터를 확보하고 일반 사용자를 위해 라마 3를 개선하기 위해 해야 할 일은 바로 이 수십억 명의 사용자들이 라마 3를 사용해 보도록 유도하는 것입니다. 이는 다른 어떤 기술 회사도 경쟁할 수 없을 정도로 많은 잠재 고객을 확보한 것입니다.

완전히 무료입니다.

메타의 CEO인 마크 저커버그의 실패한 Horizons VR 이니셔티브가 우리에게 보여준 것이 있다면, 메타는 수백억 달러를 아무 쓸모없는 프로젝트에 쏟아 붓는 데 아무런 문제가 없다는 것입니다. 하지만 다른 AI 개발자들이 비교적 빨리 투자 수익을 얻어야 하는 반면, Meta는 그럴 필요가 없기 때문에 이러한 첨단 분야에 투자하는 회사에게는 수익 창출이 필요하지 않다는 점이 놀라운 강점입니다.

거대한 데이터 센터 인프라와 다양한 서비스를 통한 탄탄한 수익원을 바탕으로 Meta는 모든 사람에게 정확히 0달러로 라마 3의 가격을 책정할 수 있습니다. 메타는 수십억 달러에 달하는 컴퓨팅 파워를 Llama 3와 향후 LLM을 개발하는 데 투자할 수 있는 여력이 있습니다. 따라서 수십억 명의 사용자가 다른 어떤 최고 수준의 AI보다 더 쉽게 라마 3에 접근할 수 있습니다.

오픈 소스입니다.

사용자에게 가격이 중요하다면 개발자에게는 코드 투명성이 중요합니다. ChatGPT 및 다양한 언어 모델과 같은 독점 플랫폼 AI와 달리 Llama 3는 오픈 소스입니다. 즉, 개발자가 실행 방식을 살펴보고 변경할 수 있습니다. 개발자는 이를 기반으로 반복 작업을 수행하여 자신만의 흥미로운 방향으로 프로젝트를 발전시킬 수 있습니다. 더 많은 개발자가 자신의 프로젝트에 라마 3 모델을 통합할 수 있으므로 더 많은 채택을 장려하고, 더 많은 사람이 개발에 영향을 미칠 수 있으므로 더 나은 코드를 장려할 수 있습니다.

이는 라마 3가 어느 정도 표준이 될 가능성이 있으며, 당분간 표준으로 자리 잡을 것입니다.

로컬에서 실행 가능

Google의 Gemini, ChatGPT 또는 이전 버전의 Meta의 Llama와 같은 대규모 언어 모델 AI의 가장 큰 단점 중 하나는 학습뿐만 아니라 실제 운영 시에도 엄청난 양의 컴퓨팅 성능을 필요로 한다는 것입니다. 그렇기 때문에 더 까다로운 AI를 사용하기 위해 비용을 지불해야 하며, 서비스가 바쁠 때 응답이 느려지는 경우도 있습니다.

하지만 Llama 3는 일반 노트북 하드웨어에서 로컬로 실행할 수 있습니다. 약간의 점프가 필요하고 효과적으로 작동하려면 많은 메모리가 필요하지만(아래 예제에서 사용된 노트북은 64GB RAM 메모리가 장착된 MacBook Pro M1 Max), 진입 장벽이 크지는 않습니다.

하지만 이것은 라마 3의 최종 버전이 아닙니다. 응답에 700억 개의 파라미터를 사용하지만, 최대 4,000억 개의 파라미터를 활용하는 내부 버전의 Llama도 있습니다. 라마 3는 로컬에서 실행되는 최초의 LLM과는 거리가 멀지만, 지금까지 가장 뛰어난 성능을 자랑하며 가까운 미래에 스마트폰, 스마트글라스, VR 헤드셋 및 기타 기기에서 이러한 종류의 AI가 실행되는 것을 볼 수 있을 것입니다.

그리고 이것은 시작에 불과합니다.

라마 3는 놀랍지만 아직은 할 수 있는 일이 많지 않습니다. 현재는 전적으로 텍스트 기반이기 때문에 ChatGPT와 유사한 서비스에서 볼 수 있었던 멀티모달 AI가 아닙니다. 비디오, 오디오, 이미지를 처리할 수 없습니다. 음성 명령에 응답하거나 사용자에게 대답할 수 없습니다. 또한 현재는 영어로만 작동합니다.

하지만 곧 이 모든 것을 할 수 있게 될 것이며, 아마도 그 이상도 가능할 것입니다. 라마 3는 소규모 스타트업이 AI 개발의 각광을 받는 시대는 끝났다는 많은 AI 개발자들에게 경고의 신호탄이 될 수 있습니다. Meta와 같은 대규모 재정, 기술, 인프라 지원 없이는 직접 경쟁하는 것이 매우 어려울 수 있습니다.

'Wellbing' 카테고리의 다른 글

| 에이미 슈머는 쿠싱 증후군 치료를 받으면서 '훨씬 나아졌다'고 말합니다. 이 질환에 대해 알아야 할 사항을 알아보세요. (0) | 2024.05.03 |

|---|---|

| 성인 ADHD의 5가지 징후 (0) | 2024.05.03 |

| 배가 더부룩한 14가지 이유 (0) | 2024.05.03 |

| 자궁경부암 검사 받기. 30세 미만 여성에게 더 이상 HPV 검사를 하지 않는 이유 (0) | 2024.05.03 |

| 스텔라 블레이드 리뷰: PS5 독점의 아름다움은 피부 깊이에 불과합니다. (0) | 2024.05.02 |

| 새로운 유방 촬영 지침: 유방암 검진은 40세부터 시작해야 한다고 전문가 패널은 말합니다. (0) | 2024.05.02 |

| 크레아틴을 섭취하기 가장 좋은 시기는 언제인가요? (0) | 2024.05.02 |

| 트레이너들이 추천하는 저강도 유산소 운동법 (0) | 2024.05.02 |